【ChatGPT系列】【影响】ChatGPT如何改变了今天的商业与科技格局?

2月24日,OpenAI发布了一则声明,叫“对AGI及以后的规划(Planning for AGI and beyond)”。AGI不是我们现在用的这些科研、画画或者导航的AI,而是「通用人工智能(artificial general intelligence)」,是不但至少要有人的水平,而且什么任务都可以干的智能。

但令人讶异的是,OpenAI的这则声明中以极其忧患的态度,担心人类该怎么接受AGI,也就是说,并非是技术原因让AGI不能达到原本设定的目标,而是人类是否做好了准备去接受AGI。

OpenAI是这么说的:“AGI有可能给每个人带来令人难以置信的新能力;我们可以想象一个世界,我们所有人都可以获得几乎任何认知任务的帮助,为人类的智慧和创造力提供一个巨大的力量倍增器。”然后文件并没有继续说AGI有多厉害,而是反复强调要「逐渐过渡」:“让人们、政策制定者和机构有时间了解正在发生的事情,亲自体验这些系统的好处和坏处,调整我们的经济,并将监管落实到位。”并且说它部署新模型会「比许多用户希望的更谨慎」。

换句话说,人类在故意拖慢AI发展的脚步,AI对于未来的变革不可想象。

。

Ⅰ AIGC(AI Generated Content/人工智能自动生成内容)的市场前景

ChatGPT本身的商业化,目前看起来会和微软深度绑定,比如接入搜索引擎必应、办公全家桶Office、云计算平台Azure。本篇把视角放得更广一些,以ChatGPT为代表的AIGC或生成式AI,试着探讨这波AIGC的产品和商业化。

2022年9月,红杉资本官网发表了一篇题为《Generative AI: A Creative New World》的重磅文章,把分成两类:分析型AI(Analytical AI)和生成式AI(Generative AI)。

分析型AI(Analytical AI)

生成式AI(Generative AI)

生成式AI有潜力产生数万亿美元的经济价值

Ⅱ AIGC产品市场格局

目前有两种版本的市场格局分析比较值得关注,一种是美国知名投资机构A16Z给出的框架,一种是OpenAI 创始人Sam Altman给出的框架。

· 投资机构A16Z版市场框架

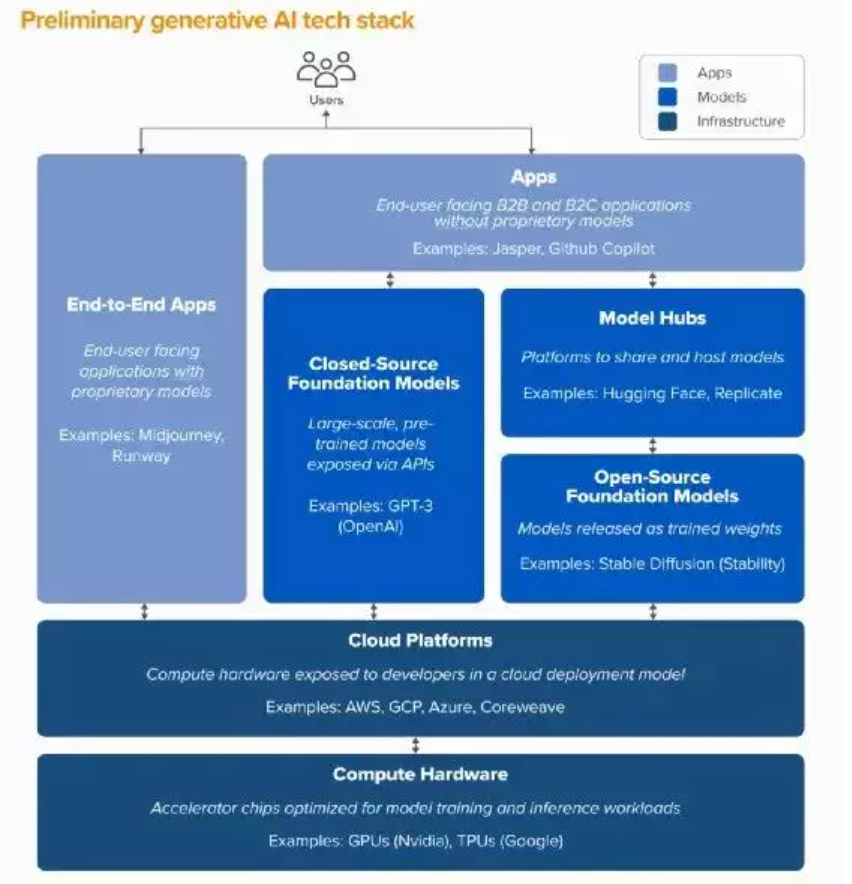

分为基础设施层(代表是英伟达的芯片、AWS/Azure云计算平台),模型层(代表是这种非开源基础模型,还有Stable Diffusion 这种开源基础模型,以及Hugging Face这种模型托管平台),应用层(Jasper为代表的开放合作派——不拥有自己的模型,以及Midjourney这种拥有自己模型的自力更生派)。

· Sam Altman(OpenAI CEO)版市场框架

以下出自Sam Altman和领英创始人Reid Hoffman的访谈:

Reid Hoffman

Sam Altman

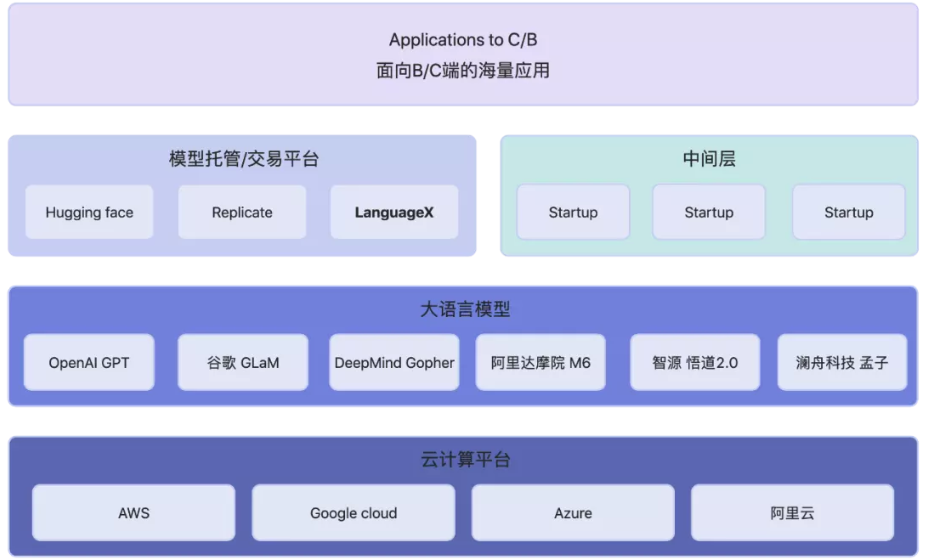

我认为,将来在基础模型和具体AI应用研发之间会有一个中间层:出现一批专门负责调整大型模型以适应具体AI应用需求的初创企业。能做好这一点的初创公司将会非常成功,但这取决于它们能在“数据飞轮”上走多远。(注:数据飞轮,指使用更多数据可以训练出更好的模型,吸引更多用户,从而产生更多用户数据用于训练,形成良性循环。)

我对初创企业训练模型的能力持怀疑态度,将来承担模型训练角色的不会是初创公司,但它们可以在上述的中间层角色中发挥巨大价值。

这是根据Altman的思路画的框架图,目前看,中间层还没有大量出现。

Ⅲ AIGC产品全景图

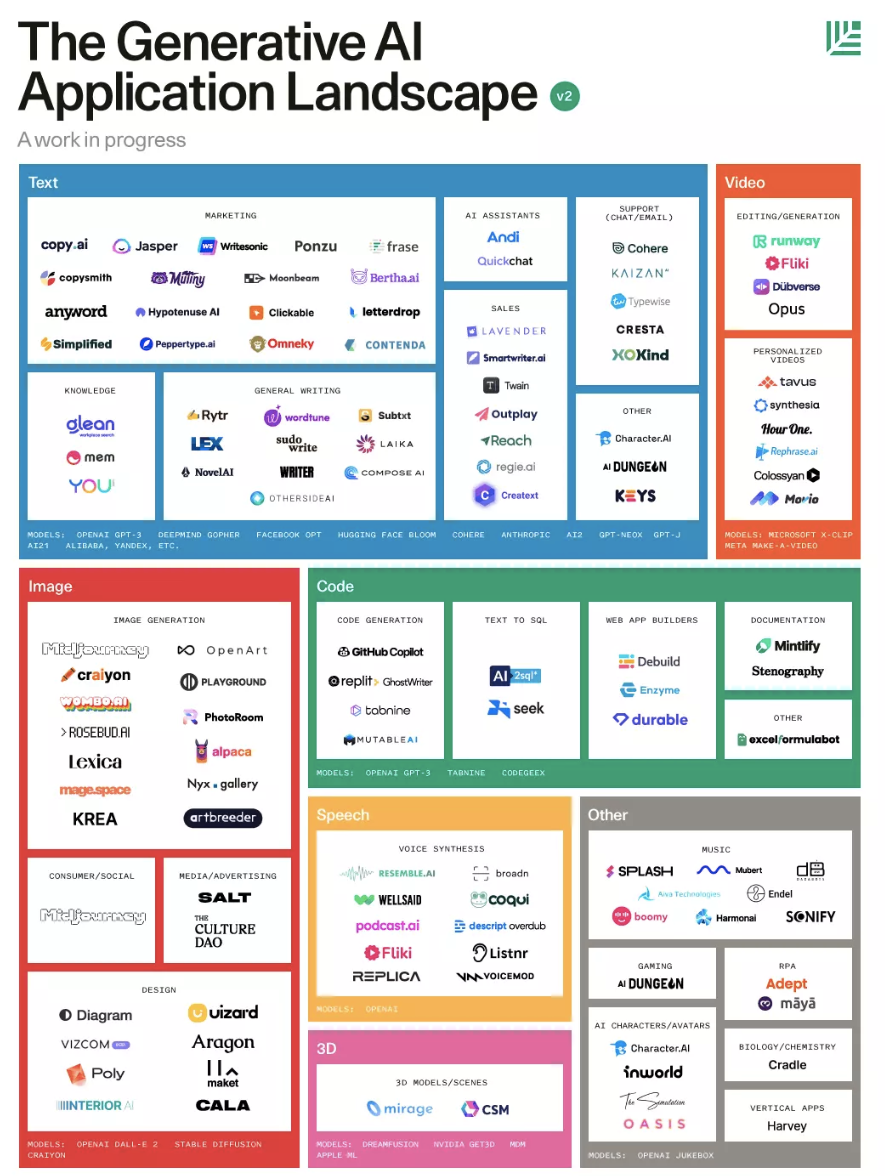

AIGC产品分类

- 文本:总结或自动化内容

- 翻译:翻译跨语言内容

- 图像:生成图像

- 音频:在音频中总结、生成或转换文本

- 视频:生成或编辑视频

- 编程:生成代码

- 聊天机器人:自动化客户服务

- 机器学习平台:应用程序/机器自学习平台

- 搜索:人工智能洞察

- 游戏:生成式AI游戏工作室或应用

- 数据:设计、收集或总结数据

- 全球AIGC产品全景图

红杉资本版生成式AI图谱_V2.0

国内市场格局(from 量子位)

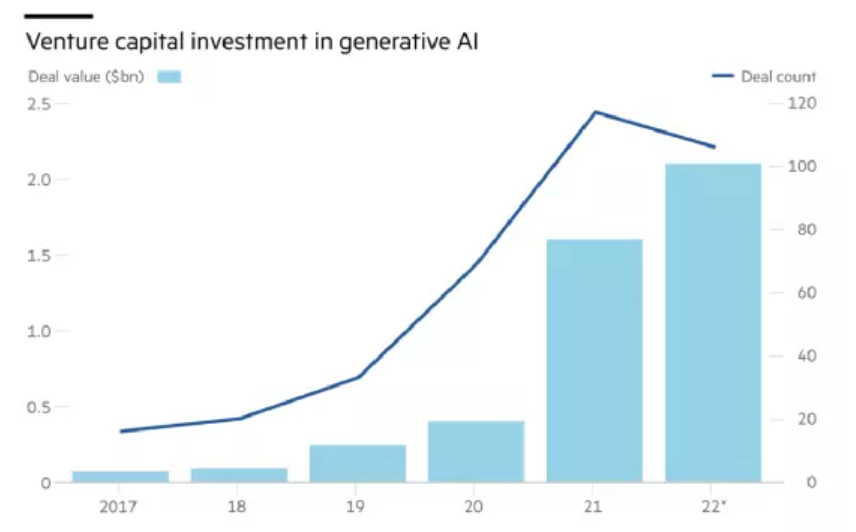

AIGC风险投资情况(from PitchBook)

Ⅳ 中国AI发展的现状

OpenAI 在 2020 年发布了 1750 亿参数的 GPT3,根据公开资料,那之后中国公司和机构发布的超过千亿参数规模的大模型包括百度发布的 Ernie(文心),华为发布的盘古大模型,和阿里巴巴发布的 M6 大模型等。

2021 年,百度基于其已有的 ERNIE 模型框架,发布了百亿参数的对话大模型 PLATO-XL,到了最新发布的 ERNIE 3.0 Zeus,模型已有千亿级参数。结合自身的 PaddlePaddle 训练框架,让 Ernie 从一开始的对中文语境的优化到现在得到全球研究者越来越多的关注。2021 年 4 月, 华为对外公布了盘古大模型。根据公开资料,其在预训练阶段学习了 40TB 的中文文本数据,并也已达到千亿级参数规模。

而 2021 年 4 月,阿里巴巴达摩院发布的 270 亿参数语言大模型 PLUG,被称为中文版「GPT-3」。同年阿里巴巴还发布了国内首个千亿参数多模态大模型 M6。

阿里巴巴的这两个大模型都在过去几年继续进化, 2021 年 10 月,PLUG 模型实现 2 万亿参数 ,2022 年 11 月,它所属的阿里通义 -AliceMind,在中文语言理解领域权威榜单 CLUE 中首次超越人类成绩。而 M6 在不断提高着训练效率,2021 年 10 月,达摩院使用 512 卡 GPU 即训练出全球首个 10 万亿参数大模型 M6,同等参数规模能耗为此前业界标杆的 1%。并且,M6 还在进一步做多模态的打通。达摩院的诸多模型集成在 2022 年发布的「通义」大模型系列中。

这些大模型的进步也引来了包括 OpenAI 在内的同行的关注,OpenAI 的前政策主管 Jack Clark 曾公开点评 M6 模型,称它「规模和设计都非常惊人。这看起来像是众多中国的 AI 研究组织逐渐发展壮大的一种表现。」

可以看出,中国的参与者并不少,参与的也并不晚,成果也并非乏善可陈,否认这一点是虚无的。而且,但凡亲自训练过大模型的研究者都不难得出结论:最好的方式就是在已有建制的基础上去继续加速。

Ⅴ 非结构化的感想总结

关于ChatGPT出现意义的一段有意思描述:

“

我们大概可以理解大名鼎鼎的图灵奖得主杨立昆(Yann LeCun)为何说ChatGPT没有革命性技术了。革命性时刻往往落后于技术研究,在象牙塔之外,甚至落后于最早一批的产品,并且充满争议……这一切,确实都会让技术先驱者很不服气。

押注文本(Always bet on text):

关于AI超越人类的视角

关于AI不如人类的视角

“如果一切顺利的话,人类历史才刚刚开始。人类大约有二十万年的历史。但地球还将保持数亿年的可居住性——为数百万的后代提供足够的时间;足以永远结束疾病、贫穷和不公正;足以创造今天无法想象的繁荣高度。如果我们能够学会进一步深入宇宙,我们就会有更多的时间:数万亿年,探索数十亿的世界。这样的寿命使人类处于最早的婴儿期。一个巨大而非凡的成年期正在等待着我们。” ——By 托比-奥德,《悬崖》

关于AIGC的市场规模:

目前为止发现了3个“ChatGPT杀手”项目:

GPTZero(普林斯顿大学的学生Edward Tian)、Detect GPT(斯坦福大学)、GPT-2 Output Detector(OpenAI和哈佛联合开发)。

GPTZero更接近商业化, 原理是检测文本的「困惑度」(Perplexity)和「突发性」(Burstiness)这两项指标,并分别对其打分,判定文本是AI还是人类写的。打败魔法的只有魔法,确实应该提升AI的透明度。

ChatGPT专栏: